Notatka

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

DOTYCZY: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Wskazówka

Data Factory w usłudze Microsoft Fabric jest następną generacją Azure Data Factory z prostszą architekturą, wbudowaną sztuczną inteligencją i nowymi funkcjami. Jeśli dopiero zaczynasz integrować dane, zacznij od Fabric Data Factory. Istniejące obciążenia ADF można zaktualizować do Fabric, aby uzyskać dostęp do nowych możliwości w zakresie nauki o danych, analiz w czasie rzeczywistym oraz raportowania.

Działanie Python w Azure Databricks w pipeline uruchamia plik Pythona w klastrze Azure Databricks. Ten artykuł opiera się na artykule dotyczącym działań przekształcania danych, który zawiera ogólne omówienie transformacji danych i obsługiwanych działań przekształcania. Azure Databricks to zarządzana platforma do uruchamiania platformy Apache Spark.

Poniższy klip wideo zawiera jedenastominutowe wprowadzenie i demonstrację tej funkcji:

Dodawanie działania Python dla Azure Databricks do potoku za pomocą interfejsu użytkownika

Aby użyć działania Python dla Azure Databricks w potoku, wykonaj następujące kroki:

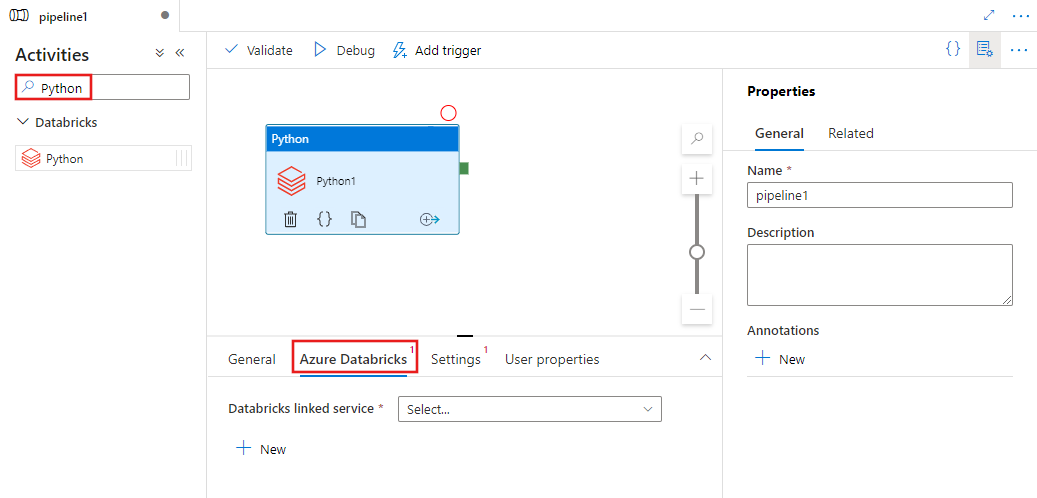

Wyszukaj Python w okienku Działania potoku i przeciągnij działanie Python na kanwę potoku.

Wybierz nowe działanie Python na kanwie, jeśli nie zostało jeszcze wybrane.

Wybierz kartę Azure Databricks aby wybrać lub utworzyć nową połączoną usługę Azure Databricks, która wykona działanie Python.

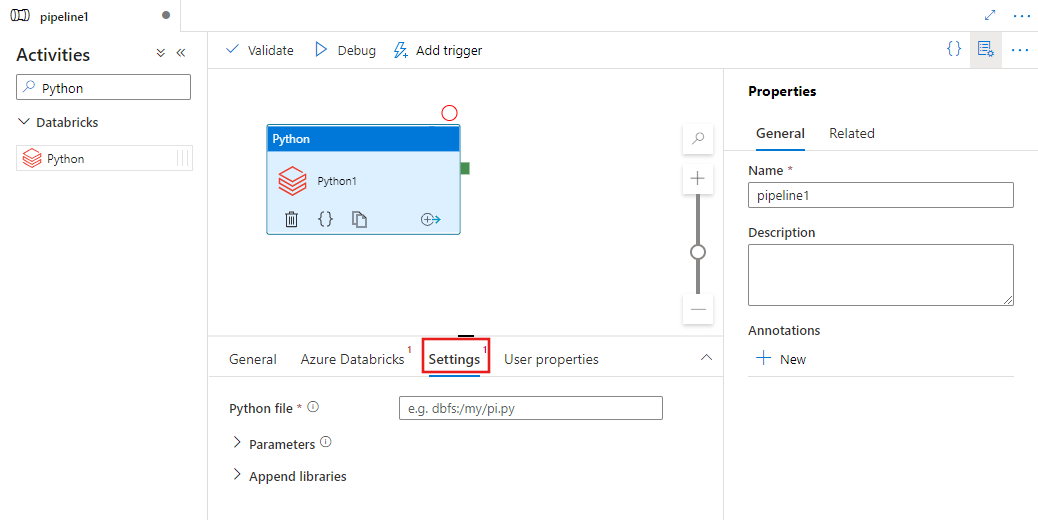

Wybierz kartę Settings i określ ścieżkę w Azure Databricks do pliku Python, który ma zostać wykonany, opcjonalne parametry do przekazania, a także wszelkie dodatkowe biblioteki do zainstalowania w klastrze w celu wykonania zadania.

Definicja działania usługi Databricks Python

Oto przykładowa definicja JSON działania usługi Databricks Python:

{

"activity": {

"name": "MyActivity",

"description": "MyActivity description",

"type": "DatabricksSparkPython",

"linkedServiceName": {

"referenceName": "MyDatabricksLinkedService",

"type": "LinkedServiceReference"

},

"typeProperties": {

"pythonFile": "dbfs:/docs/pi.py",

"parameters": [

"10"

],

"libraries": [

{

"pypi": {

"package": "tensorflow"

}

}

]

}

}

}

Właściwości działania Python usługi Databricks

W poniższej tabeli opisano właściwości JSON używane w definicji JSON:

| Właściwości | Opis | Wymagane |

|---|---|---|

| nazwa | Nazwa działania w pipeline. | Tak |

| opis | Tekst opisujący działanie. | Nie. |

| typ | W przypadku działania usługi Databricks Python typ działania to DatabricksSparkPython. | Tak |

| linkedServiceName | Nazwa połączonej usługi Databricks, na której działa działanie Python. Aby dowiedzieć się więcej o tej połączonej usłudze, zobacz artykuł Dotyczący połączonych usług obliczeniowych. | Tak |

| pythonFile | URI pliku Python przeznaczonego do wykonania. Obsługiwane są tylko ścieżki systemu plików DBFS. | Tak |

| parametry | Parametry wiersza polecenia, które zostaną przekazane do pliku Python. Jest to tablica ciągów. | Nie. |

| biblioteki | Lista bibliotek, które mają być zainstalowane w klastrze, które będą wykonywać zadanie. Może to być tablica ciągów <, obiektów> | Nie. |

Obsługiwane biblioteki dla działań usługi Databricks

W powyższej definicji działania usługi Databricks określ następujące typy bibliotek: jar, egg, maven, pypi, cran.

{

"libraries": [

{

"jar": "dbfs:/mnt/libraries/library.jar"

},

{

"egg": "dbfs:/mnt/libraries/library.egg"

},

{

"maven": {

"coordinates": "org.jsoup:jsoup:1.7.2",

"exclusions": [ "slf4j:slf4j" ]

}

},

{

"pypi": {

"package": "simplejson",

"repo": "http://my-pypi-mirror.com"

}

},

{

"cran": {

"package": "ada",

"repo": "https://cran.us.r-project.org"

}

}

]

}

Aby uzyskać więcej informacji, zobacz dokumentację usługi Databricks dotyczącą typów bibliotek.

Jak załadować bibliotekę w usłudze Databricks

Możesz użyć interfejsu użytkownika obszaru roboczego:

Korzystanie z interfejsu użytkownika obszaru roboczego usługi Databricks

Aby uzyskać ścieżkę dbfs biblioteki, która została dodana za pomocą interfejsu użytkownika, możesz użyć Databricks CLI.

Zazwyczaj biblioteki Jar są przechowywane w obszarze dbfs:/FileStore/jars podczas korzystania z interfejsu użytkownika. Możesz wyświetlić listę za pomocą CLI: databricks fs ls dbfs:/FileStore/job-jars

Możesz też użyć interfejsu wiersza polecenia usługi Databricks:

Postępuj zgodnie z instrukcjami kopiowania biblioteki przy użyciu interfejsu wiersza polecenia usługi Databricks

Użycie interfejsu CLI Databricks (kroki instalacji)

Aby na przykład skopiować plik JAR do systemu dbfs:

dbfs cp SparkPi-assembly-0.1.jar dbfs:/docs/sparkpi.jar